Mój tegoroczny pobyt na #BettUK2024 związany był głównie z szeroko rozumianym zagadnieniem AI. Intrygowało mnie, co na temat rozwijających się możliwości sztucznej inteligencji mogą mi powiedzieć eksperci z całego świata.

Generatywna sztuczna inteligencja (Gen-AI) to forma sztucznej inteligencji, która tworzy oryginalny tekst, obrazy i dźwięk. Modele Gen-AI są szkolone na zbiorach danych wykorzystywanych do tworzenia nowych treści, w oparciu o wzorce wyuczone podczas procesu uczenia [ŹRÓDŁO].

Innymi słowy Gen-AI, to taki twórca collage’y na zamówienie. Wykorzystuje dostępne w sieci dane (a dzięki social mediom dostarczamy mu sami całkiem pokaźną bazę), następnie przetwarza je i konfiguruje, by finalnie realizować odpowiedzi na nasze prompty (inaczej zapytania). Gen-AI szybko się uczy, bo dostrzega naszą różnorodność. Copilot Microsoftu potrafi już dostosowywać styl odpowiedzi do potrzeb odbiorcy, a wygenerowane w MS Designer obrazy już coraz rzadziej wyglądają jak nieudolnie połączony zlepek powycinanych elementów; tworzą spoistą narrację w języku tekstu kultury. Prowadzona na czacie rozmowa (ChatGPT lub Bing) przypomina swobodną pogawędkę, automat używa tranzycji, zwrotów retorycznych, skutecznie stosuje funkcję fatyczną, nierzadko obrażony reaguje ekspresywnie i usilnie stara się mnie przekonać, że znalazł to, czego szukałam (impresja).

[Zestaw narzędzi Microsoft Education: https://msft.it/6049iIxgv]

Zgłaszając się na tegoroczny Bett, wyraziłam również chęć uczestniczenia w dyskusji przy stolikach (#TableTalks). Ku mojemu zaskoczeniu, zostałam przyjęta i w czwartek znalazłam się przy stole z pięcioma obcymi mi osobami, by rozmawiać na temat: Is it safe yet? The benefits and challenges of integrating generative AI into your institutions.

Byli to: Aashish Mandhwani (kierownik ds. technologii edukacyjnych w The Shri Ram Schools w Indiach), Andy Crissell (prowadzi zajęcia z zakresu kształcenia nauczycieli, South Essex College), Jon Howard (Executive Product Manager BBC, współpracuje z Uniwersytetem w Northampton), Oskar Hansson (koordynatorem ICT w Linköping w Szwecji), Peter Demeester (dyrektor programowy zawodowych studiów licencjackich Electronics-ICT w Odisee University College w Gandawie, Belgia) no i ja.

Zgodnie z zaleceniami organizatorów, przedstawiliśmy się sobie, a następnie rozpoczęliśmy rozmowę w odniesieniu do trzech pytań. Poniżej zebrałam refleksje dyskutantów.

Czy to jest już bezpieczne? Korzyści i wyzwania związane z integracją generatywnej sztucznej inteligencji w instytucjach.

1. Jakie są według Ciebie trzy największe korzyści wynikające ze stosowania generatywnej sztucznej inteligencji w edukacji?

• Wykorzystanie kreatorów nie jest tylko twórczą zabawą – zastępuje pozyskiwanie ilustracji objętych prawem autorskim

• Możliwość prowadzenia pogłębionej rozmowy, wieloaspektowość odpowiedzi AI

• Kreacja AI: narracja, fun fiction, planowanie rozwoju wątków

• Pozorna neutralność – tylko od nadawcy promptu zależy kierunek rozważań i poszukiwań AI

• Zmiana perspektywy – AI tworzy odpowiedzi wieloaspektowo, przedstawia wiele źródeł

• Krytyczne myślenie – dany fakt jest przedstawiany z wykorzystaniem różnych źródeł, których wartość można sprawdzić

2. Jakie są Twoje wątpliwości etyczne dotyczące stosowania sztucznej inteligencji w edukacji? Czy masz inne obawy?

• Deep fake – zatarcie granicy między faktem a manipulacją

• Etyka persony - ile lat ma AI? Tworzymy zasoby AI, co przypomina uczenie dziecka. 10 lat temu Google Translator był, można założyć, 10 latkiem w zdolności tłumaczenia, jednak tak długo powtarzaliśmy mu różne struktury słowne, że teraz potrafi podpowiedzieć, co jest popularne, co stylistycznie błędne - jesteśmy jego rodziną uczącą, społecznością, w której wzrasta. I jak dziecko, które jest odbiciem rodziców i miejsca przebywania, tak AI jest naszym lustrem i wychowankiem. Ma naszą duszę, czyli ma też tożsamość? Charakter?

• Copy paste – bezrefleksyjne powielanie treści przez użytkowników

• Mnogość niekreatywności – zatracenie zdolności wytwarzania „z niczego”, konieczność przekształcania (nie tworzenia), pracowania na podbudowie

• Bazowanie na uproszczeniach, niechęć do samodzielnego zgłębiania, poszukiwania wiedzy

• Wejście w strukturę kopii – czy AI może indywidualizować wrażenia, subiektywnie przeżywać i wyrażać emocje?

• Kwestia odpowiedzialności za decyzje - czy działania podpowiadane lub podejmowane przez sztuczną inteligencję są błędem sztucznej inteligencji lub jej ludzkiego twórcy/wykonawcy podpowiedzi/autora promptu?

• Od jakiego momentu maszynę należy nazwać AI?

• Skoro AI udowadnia doświadczanie wyższych emocji (np. troski, współczucia) i indywidualnych cech charakteru, to czy nie powinno być objęte prawami osobistymi jako osoba? Culture literacy: regarding the films "The Creator" (2023), "I, Robot" (2004) and "Ghost in the Shell" (1995)

3. Czy i w jaki sposób można złagodzić te obawy? Jakie wskazówki ze strony rządu byłyby przydatne?

• Stop uczenia pod testy i oceny. Powinna zajść głęboka zmiana dotycząca edukacji. Nastawienie na rozwój, nie na ocenę, pozwoli wyeliminować nastawienie na „zaliczenie” tematu i bezkrytyczne ściąganie gotowców. Uczenie do umiejętności dojrzałych, nie do zakucia, co wiąże się ze wzmacnianiem sensu zdobywania wiedzy, wyjaśnianiem, po co warto się uczyć. Pozwoli to kształtować postawę skupioną na samorozwoju oraz rozbudzi chęć zgłębiania i budowania wiedzy.

• Obligatoryjnie należy wypracować w ludziach mechanizmy etyczne, pozwalające korzystać z czatu jako narzędzia. Podobnie jak lekcje chemii mogą zainspirować przyszłą Marię Curie-Skłodowską albo Waltera White’a (bohatera filmu „Braking Bad”), tak AI w rękach osoby nieprzygotowanej etycznie do jej wykorzystania, może okazać się bronią lub drogą do osiągnięcia partykularnych interesów. Więc problem nie tkwi w narzędziu, a w mechanizmach etycznych jego wykorzystania.

• Uregulowanie użycia AI w przestrzeni publicznej, szczególnie w mediach, np. ostrzeżenia dotyczące przetwarzania obrazu, silniejsze narzędzia umożliwiające śledzenie np. obrazu, wyszukiwanie cytatów

• Zdefiniowanie, co należy rozumieć jako AI. Na tej podstawie opracować czytelne, wspólne zasady korzystania z Gen-AI.

• Konieczność odejścia od zajęć wykładowych, a więcej angażować uczniów w dyskusję, pobudzać do samodzielności myślenia i krytycznej oceny posiadanych lub pozyskanych zasobów wiedzy

• Gen-AI należy łączyć z celowymi działaniami, np. flipped lesson i krytyczne myślenie (zdolność nieograniczania się do jednej wizji prawdy i przeciwdziałanie polaryzacji decyzji). Wychodzić poza fakt wyszukania lub pozyskania czegoś przy pomocy AI (czyli znów powrót do modelu SAMR i świadomego wykorzystania narzędzi cyfrowych)

• Team teaching, kooperacja, współzależność, a nie atomizacja jednostek nastawionych na ocenę lub wynik na egzaminie, który nie daje nic poza wynikiem.

• Nie demonizować, a oswajać, a użytkownikom towarzyszyć, a nie wyłącznie zakazywać, tym samym broniąc się przed wizją Goldinga.

W tym samym dniu wysłuchałam kilku debat na temat Gen-AI.

1) „From potential to practice: how generative AI is improving education for students and educators” (Arena).

Paneliści: Leanne Hurrell (Amazon) Andrew Clubb (McGraw Hill), Alex Russell (Bourne Education Trust), Scott Trowbridge (wiceprezes ds. rozwoju biznesu – Stability AI)

Generatywną sztuczną inteligencję chwalono za jej potencjał zrewolucjonizowania edukacji, jednak wiele instytucji nie ma pewności co do jej optymalnego wykorzystania z korzyścią zarówno dla pracowników, jak i studentów.

Korzyści: dzięki AI można skuteczniej zarządzać szkołami, prowadzić nie tylko nadzór, ale na podstawie danych projektować kierunki rozwoju. W SEN (special educational needs) Gen-AI stanowi pomoc w dostępności do edukacji (generatory głosu, technologia zastępująca w przypadku utrudnionej mobilności), ułatwia dostosowanie edukacji (np. Immersive Reader i Reader Coach). AI może wspomagać w przygotowaniu tutoringu expertów dla klasy oraz tworzyć prototypowe rozwiązania (użycie wiedzy), specyficzne pułapki zastosowań (co mnie skojarzyło się z symulacją wgrywaną Neo w „Matrixie”, w których bohater zapatrzył się na kobietę w czerwonej sukience, co miało go nauczyć czujności na osoby agentów).

Trudności: zabezpieczenie danych (paneliści nie mieli pomysłów, jak tego dokonać), rozważania dotyczące niezbędnych regulacji koniecznych do bezpiecznego wykorzystania tej technologii w edukacji zostały pominięte (a szkoda).

2) „The global impact of AI on learning and children's safety” (Arena).

Paneliści: sir Peter Wanless (dyrektor naczelny NSPCC), Jim Steyer (założyciel i dyrektor generalny Common Sense Media) - szefowie dwóch wiodących organizacji charytatywnych na rzecz dzieci.

Sztuczna inteligencja może zapewnić dzieciom ogromne korzyści i być potężną siłą pozytywnych zmian w edukacji, ale dzieci są szczególnie narażone na niewłaściwe wykorzystanie danych, błędne praktyki dotyczące prywatności oraz szkody wynikające z nieodpowiednich treści lub dezinformacji. Jako liderzy dwóch najbardziej wpływowych organizacji na rzecz dzieci na świecie Jim Steyer i Peter Wanless podzielili się globalnymi perspektywami na temat możliwości i potencjalnych szkód związanych ze sztuczną inteligencją, uczeniem się i zdrowiem psychicznym młodzieży.

Trudności:

Plastyczność nauczycieli (w sumie padło mnóstwo uogólnień w odniesieniu do rzekomego zatwardziałego charakteru statystycznego nauczyciela, przywiązanego do swych starych i wypracowanych metod jak niemalże do kodeksu rycerskiego, echhh).

Nieprzystawalność podstaw programowych do kompetencji kluczowych. Wielu uczniów nie odnajduje się w założeniach podstawowych programowych. W tym również ujęto przepaść pomiędzy szkolą, a startem w dorosłość. Źródłem problemu jest, zdaniem rozmówców, uczenie pod egzamin, nie pod umiejętności.

Zawartość jest bezpieczna - a co z użytkownikiem? Rozmówcy dostrzegli, że zachwalane jest narzędzie, nie metody korzystania z niego.

Ćwiczenie krytycznego myślenia powinno być w szkole ważniejsze od wiedzy encyklopedycznej.

Wnioski (key notes):

- dajmy przestrzeń na eksperymentowanie, sprawdzanie możliwości AI (nauczyciel-tutor), nadając jednocześnie tym działaniom kierunek i funkcję, z dbałością o krzewienie zasad etycznych dot. wykorzystywania narzędzia

- promowanie dobrych praktyk i przykładów, by uczniowie poszukiwali idoli w obszarze etycznych twórców, użytkowników Gen-AI.

3) „Language learning: Is it still needed in the age of AI?” (Global Futures).

Paneliści: prof. Barry O'Sullivan (kierownik działu badań i rozwoju w zakresie oceniania oraz dyrektor ds. badań nad językiem angielskim – British Council), prof. Kaska Porayska-Pomsta (Sztucznej Inteligencji w Edukacji - UCL), Geoff Stead (MyTutor)

Jakie są dowody na to, że sztuczna inteligencja w edukacji językowej działa i jak można ją ulepszyć? Czy sztuczna inteligencja mogłaby pomóc w podejmowaniu nauki języków? Czy w dzisiejszym, coraz bardziej cyfrowym świecie, nauka języków nadal będzie ważna?

Rozważania:

Technologia pomaga w zrozumieniu się nawzajem (powołanie się na publikację "What Technology Wants" Kevin Kelly; tutaj słuchowisko na ten temat)

Rozmówcy nie mieli pewności, czy AI osiągnie zdolność kreatywności językowej, co jest najistotniejszą wartością języka. Przed ludźmi stoi również wyzwanie: uczenie się nowego języka AI (np. tworzenie promptów). Rozwinie to myślenie o tym, jak się uczy języka, zamiast skupienia na tym, żeby uczyć.

Czy AI może zastąpić człowieka w uczeniu języka? Praca z AI to zgłębianie wiedzy, czy tworzenie nowego zasobu? Prof. Sullivan uważa, że trzeba zacząć metodykę nauczania języków od nowa (jego zdaniem ważniejszy jest sam proces odkrywania języka, niż świadomość osiągnięcia jakiegoś „poziomu”. Rozmówcy dodali, że testy, to statystyka, a nie wiedza o języku. W tym procesie może człowiekowi asystować AI, prowokując do rozmowy (poniekąd bezpiecznej, bo będącej tylko symulacją, np. przy pomocy ChatuGPT).

Czy jest jakaś dodatkowa możliwość, która daje AI? Jak zadać poprawne pytanie o rolę AI? Czy może być tak, że AI przewyższy zdolności rodzimych użytkowników języka, jak miało to miejsce z dokonaniami tłumaczy, którzy stworzyli swoiste dzieło w dziele, np. „Sto lat samotności” w przekładzie Gregory'ego Rabassy?

AI nie zastąpi ekspresji emocji, a jednak są już próby imitowania niewerbalnej komunikacji – awatary, deep fake, generatory emocji w aplikacjach, naśladowanie ekspresji mowy w Adobe Express (awatar przekłada mowę na ruchy postaci, bazując na układzie twarzy podczas wokalizacji samogłosek!)

Co jest elementem działającym w nauce języka? Czemu się uczymy języka?

Jak AI nauczy się niewerbalności? Co wykorzystuje z tzw. „Big data” do tworzenia odcieni znaczeniowych, wariantów stylu? Czy wsparciem dla AI do rozumienia wielowymiarowości komunikatów mogą być hasztagi połączone ze zdjęciami w social mediach?

AI uczy się z wielości decyzji, a my ją karmimy, jak translatory, które najpierw były nieudolne, ograniczały swe zdolności do stałych fraz, a na naszych ocenach tłumaczeń przyswoiły sobie reguły idiomów, poetykę i stylizację. Ekspresja każdego języka jest inna, ale czy AI nie uczy się ciągle jak dziecko?

Niebezpieczeństwo: płytkie uczenie się i nauczanie (shallow learnin), bazowanie na gotowych schematach, kopiowanych wzorcach.

Czy więc warto uczyć się języków obcych? Trzeba, bo AI nie wejdzie w tkankę języka tak bardzo - metaforyka, uzus słowny, frekwencyjność użycia słów i fraz, celowana stylistyka: to jeszcze przed AI. Choć już ma duszę, jest duchem w pancerzu, tylko na razie zupełnie nieświadomym.

4) „AI in education: Now and what's coming next” (Teaching & Learning).

Paneliści: Stuart Walker (dyrektor ds. edukacji Intel UK), Laura Giddings (Digital Futures, Uniwersytet w Birmingham), Kirsty McFaul (starszy specjalista ds. edukacji, Szkocja), Jason Feig (dyrektor ds. partnerstw, edukacja podstawowa i średnia – Khan Academy), Ty Goddard (dyrektor Fundacji Edukacyjnej i przewodniczący Edtech UK)

W jaki sposób sztuczna inteligencja jest obecnie wykorzystywana w szkołach i innych środowiskach edukacyjnych oraz jej potencjalnym wpływem w przyszłości. Co rosnące rozpowszechnienie narzędzi AI w edukacji oznacza dla społeczności, rozwoju umiejętności oraz instytucjonalnych i regionalnych strategii cyfrowych?

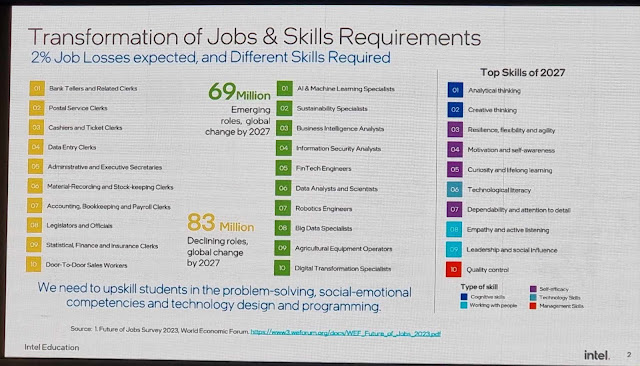

Rozmówcy rozpoczęli od wróżenia przyszłości w zakresie zmiany zawodów. Oczywiście wyrazili niepokój, czy zmiana uczenia nadąża i jest w stanie skonfrontować się z przyszłością. Echh, ciągle to samo – AI zabierze mi pracę, szkołą nie przygotowała mnie do starcia z AI, będę za ludzki dlatego mniej konkurencyjny na rynku pracy w przyszłości.

Oczywiście, oberwało się też nauczycielom, którzy, zdaniem panelistów, w reakcji na konieczność redefinicji warsztatu i włączenia zagadnień dotyczących AI, myślą tylko o tym, gdzie to wepchnę do podstawy programowej. Krzywdzące uproszczenie.

Salman Khan, pomysłodawca Khan Academy, podobno obawia się o utracenie pierwiastka ludzkiego przy korzystaniu z Chat-GPT4. Myślę, że podobne obawy towarzyszyły tym, którzy wróżyli ogłupienie i atomizację osobom czytającym w transporcie publicznym gazety sto lat temu. Mimo to powstał eksperyment sztucznego tutora „Khanmigo”, gdyż paneliści spójnie utwierdzali się w przekonaniu, że prowadzenie lekcji dla grup, to metoda nieskuteczna, tym samym prezentując antyczne rozumienie nauczania grupy, że niby ukierunkowanie działań edukacyjnych do wszystkich/wielu na raz, to w rzeczywistości do nikogo (echhh). Rozmówcy zachwycali się za to metodą… scaffolding (!), z egzaltacją mówiąc o szczeblach, ale nie podając konkretów, jak w te działania włączyć AI.

Co pominięto? W ogóle nie było rozmów o naturze ludzkiej, np. o wielu przypadkach, kiedy użytkownicy uczyli AI przeklinania. Dlaczego to robili? Jaka baza rozumienia człowieka przez maszynę jest tworzona przez dostarczanie takiego zasobu informacji?

_Elements%20of%20a%20Good%20Prompt-1.png)

Asia, dzięki za tak szczegółowe sprawozdanie. To ważne znać podejście nauczycieli z innych stron świata.

OdpowiedzUsuńBardzo dziękuję za to podsumowanie. Zestawiłaś to, co najistotniejsze. Szkoda, że najtrudniejsze kwestie nadal są znakami zapytania.

OdpowiedzUsuń